‘AI-first’: sí, pero con expertos humanos garantizando seguridad y control

- Opinión

La creciente adopción de la inteligencia artificial redefine la eficiencia y la automatización en las organizaciones, pero también evidencia la necesidad de reforzar la supervisión humana, la seguridad y la responsabilidad para garantizar decisiones fiables, éticas y alineadas con un valor estratégico.

Por David Castro, Director de Low-Code en Glintt Next

La inteligencia artificial está hoy presente de forma transversal en nuestras vidas y en las organizaciones. Desde el código que escribimos hasta los análisis financieros, desde las decisiones clínicas hasta las elecciones personales cotidianas. Esta omnipresencia genera ganancias de eficiencia innegables, pero también plantea un riesgo evidente: no podemos entregar ni las empresas ni la sociedad a la IA sin comprometer aquello que define el propósito humano —el pensamiento crítico, el contexto, la responsabilidad y la dignidad.

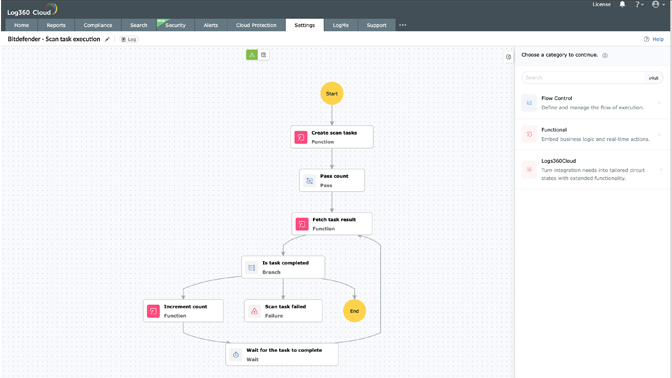

Hace diez años, cuando comencé a adoptar plataformas low-code, el objetivo era claro: acelerar el desarrollo y simplificar procesos. Hoy, con la inteligencia artificial, ese potencial se ha multiplicado. La generación automática de código, las integraciones o la automatización de flujos alcanzan velocidades que hace poco parecían impensables.

Sin embargo, cuanto mayor es la velocidad, mayor debe ser también el control, especialmente en materia de seguridad de sistemas y datos. Los beneficios reales de la IA solo se materializan cuando existen expertos dentro del proceso: profesionales con conocimiento funcional, técnico y estratégico capaces de evaluar críticamente cada resultado generado por los algoritmos y proteger adecuadamente la información sensible. Sin esa supervisión humana experta, los errores pueden pasar desapercibidos bajo una peligrosa sensación de confianza en la máquina, exponiendo vulnerabilidades como brechas de seguridad, fugas de datos o ataques cibernéticos. El resultado son fallos operativos, riesgos regulatorios y, en última instancia, una erosión de la confianza institucional.

La presión por reducir costes está alimentando además una lógica preocupante: sustituir especialistas por perfiles generalistas que simplemente "operan IA". En los informes trimestrales puede parecer una decisión eficiente. Pero a largo plazo supone debilitar capacidades esenciales dentro de las organizaciones, también en ámbitos críticos como la seguridad y la protección de sistemas.

Los algoritmos optimizan patrones de datos. No comprenden el contexto organizativo, ni los dilemas éticos, ni los impactos sociales a largo plazo, ni las nuevas amenazas de seguridad que pueden afectar a los sistemas de inteligencia artificial. Delegar decisiones críticas en sistemas automatizados sin supervisión humana no es eficiencia. Es, en realidad, una renuncia a la responsabilidad empresarial.

Y la responsabilidad sigue siendo humana. Cuando se producen incidentes operativos, decisiones sesgadas, problemas regulatorios o brechas de seguridad la culpa no recae en los modelos generativos, recae en las organizaciones y en los líderes que decidieron adoptarlos sin la gobernanza adecuada.

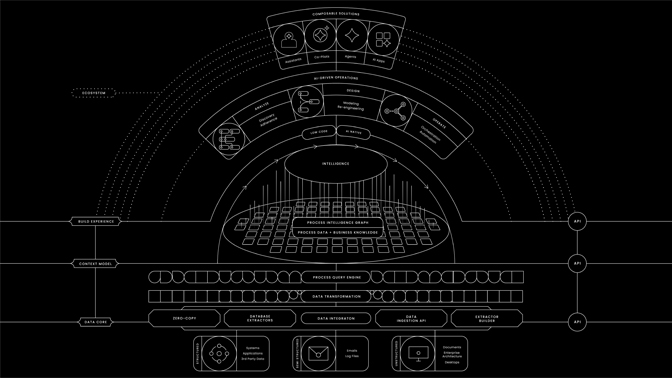

Las compañías que realmente quieren ser AI-first están empezando a entenderlo. Construyen estructuras de gobernanza sólidas, crean centros de excelencia con expertos dedicados en seguridad y establecen mecanismos de doble validación humana. También empiezan a medir algo que durante años se ha ignorado: el valor de la supervisión humana, incluyendo indicadores sobre seguridad y cumplimiento.

Un buen ejemplo lo encontramos en la aviación. Los sistemas de piloto automático existen desde hace décadas, pero ningún avión vuela sin pilotos certificados capaces de intervenir en situaciones críticas. Cuando se producen fallos sistémicos, lo que marca la diferencia es el juicio humano. Con la inteligencia artificial ocurre algo parecido. Las organizaciones necesitan "pilotos de IA": equipos preparados para analizar, cuestionar y asumir la responsabilidad de las recomendaciones automatizadas.

La automatización debe servir para acelerar procesos y liberar tiempo. Pero esa aceleración solo tiene sentido si va acompañada de formación continua y de profesionales capaces de entender lo que están implementando, incluyendo buenas prácticas para proteger la información y los sistemas.

Un profesional que no comprende el código que utiliza —ya sea generado por IA o copiado de otra fuente— no aporta valor estratégico. Simplemente ejecuta tareas y, en el peor de los casos, puede poner en riesgo a su propia organización, por ejemplo al cometer errores que comprometan información importante.

Por eso contar con expertos dentro del proceso no es un lujo, sino una inversión esencial. Son ellos quienes garantizan la arquitectura de confianza sobre la que deben construirse las organizaciones digitales, asegurando buenas prácticas y control responsable en cada etapa.

La automatización debería permitirnos concentrarnos en actividades de mayor valor. No convertirnos en dependientes de sistemas opacos que nadie comprende del todo, cuidando siempre la integridad de la información y de los procesos. Las empresas y las sociedades más maduras serán aquellas capaces de equilibrar tecnología con conocimiento humano, preservando la seguridad, la dignidad, la equidad y el control consciente sobre el futuro que estamos construyendo.

Podemos —y probablemente debemos— aspirar a ser organizaciones AI-first. Pero siempre con expertos competentes en el centro del proceso. Porque las máquinas pueden sugerir caminos. Los destinos, sin embargo, siguen siendo responsabilidad de las personas.