La IA escala el riesgo de la suplantación de identidad

- Seguridad

La inteligencia artificial, sumada a las técnicas clásicas de ingeniería social, ha provocado que estos ataques sean mucho más difíciles de identificar. Incluso sistemas a priori tan fiables como los de reconocimiento facial están en riesgo, como han demostrado desde ESET.

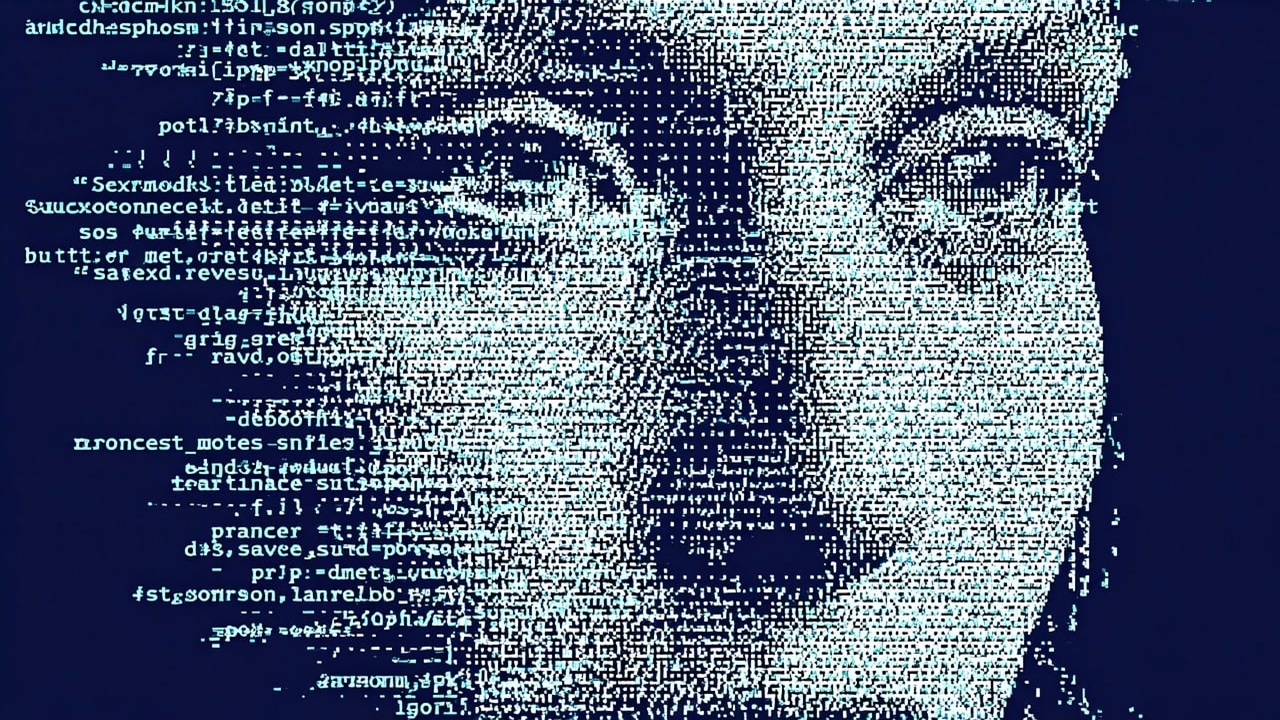

La IA generativa a contribuido al crecimiento exponencial del volumen de ciberataques, pero tiene su cara más visible, literalmente, en las amenazas de suplantación de identidad. ESET se detiene particularmente en dos elementos que están siendo fundamentales en este tipo de ciberamenazas: la manipulación de la voz mediante técnicas de clonación y los riesgos asociados a la biometría facial.

Una voz clonada puede ser muy eficaz a la hora de intentar, por ejemplo, el fraude del CEO. La compañía recuerda, además, que es posible generar una voz sintética creíble a partir de una breve muestra de audio. Y destaca, en todo caso, que el verdadero riesgo es la combinación entre este tipo de tecnologías y las técnicas ya conocidas de ingeniería social.

Respecto a la biometría facial, Jake Moore, Global Cybersecurity Advisor de ESET, ha realizado varias pruebas que ponen en tela de juicio su fiabilidad. En un experimento, modificó gafas inteligentes para identificar a personas en tiempo real partiendo de su rostro y consultar sus datos públicos online, en lo que parece una distopía digna de Black Mirror.

Las que ponen más en evidencia los sistemas de biometría facial son las otras dos pruebas. En una de ellas, el experto creó con IA un rostro ficticio y con él fue capaz de abrirse una cuenta bancaria auténtica. En otra, evitó ser reconocido por un sistema de vigilancia facial en el metro de Londres con un software de intercambio de rostro que superpuso la cara de Tom Cruise sobre la suya.

Josep Albors, director de Investigación y Concienciación de ESET España, considera que “la cuestión de fondo no es únicamente que existan deepfakes o herramientas de clonación, sino que estas tecnologías están rebajando la barrera técnica, reduciendo costes y aumentando el realismo con el que puede simularse una identidad. En la práctica, eso permite que ataques ya conocidos evolucionen hacia escenarios mucho más convincentes y difíciles de detectar, tanto para las personas como para ciertos sistemas automatizados”.