Más de 300.000 credenciales de ChatGPT aparecen a la venta en el mercado negro

- Seguridad

Muchos empleados introducen información crítica en plataformas de IA sin formación ni control, lo que está generando un nuevo frente de riesgo para las compañías. La filtración masiva de credenciales de ChatGPT confirma el creciente interés de los ciberdelincuentes por estas cuentas.

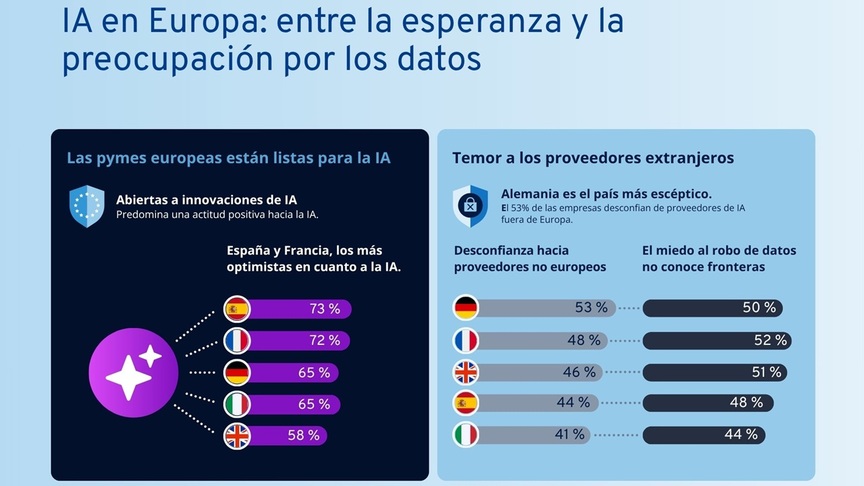

La adopción de herramientas de inteligencia artificial en las empresas continúa creciendo, y en España ya las utiliza más del 20% de las organizaciones. Pero esta expansión está generando un efecto secundario preocupante: la exposición involuntaria de datos sensibles. Según Pandora FMS, cada vez más empleados utilizan plataformas como ChatGPT para resumir documentos internos, contrastar información o incluso redactar textos oficiales, sin ser conscientes del riesgo que supone introducir contenido confidencial en estos sistemas.

“Hay quien usa los chatbots para resumir documentación oficial o crear textos legales con información muy privada. Es un peligro”, advierte Sancho Lerena, CEO de Pandora FMS. “No es lo mismo utilizar ChatGPT para cosas del hogar que introducir datos sensibles del día a día interno de tu empresa”.

Pandora FMS alerta de que se han detectado más de 300.000 credenciales de ChatGPT a la venta en el mercado negro. Esta cifra refleja el enorme valor que tiene para los ciberdelincuentes acceder a cuentas de plataformas de IA, donde pueden encontrar documentos internos, comparativas de negocio, borradores estratégicos, datos de empleados o clientes e información financiera o operativa.

ChatGPT ya es tan crítico como cualquier SaaS corporativo

La cantidad de información que los empleados introducen en estas plataformas ha convertido a ChatGPT en un activo tan sensible como cualquier herramienta SaaS empresarial. Pandora FMS advierte de que prácticas como reciclar contraseñas, compartir usuarios o permitir el uso de IA sin formación pueden poner en riesgo a toda la organización.

“Si se reciclan contraseñas, se comparten usuarios o se pone en manos de personal no cualificado la IA, la empresa puede ponerse ella misma en peligro. Es como tener el enemigo en casa”, afirma Lerena.

El uso de ChatGPT y otras plataformas de IA se ha extendido a sectores donde la confidencialidad es esencial, como despachos de abogados que redactan escritos legales, empresas que introducen datos internos para generar comparativas, u organizaciones que plantean escenarios estratégicos completos para obtener simulaciones. Esta dependencia creciente multiplica el impacto potencial de una filtración de credenciales.

El riesgo se agrava en un país donde los ciberataques siguen aumentando. Según datos del INCIBE, los incidentes crecieron un 26% en el último año, superando los 122.000; los sistemas vulnerables aumentaron un 29%, por encima de 237.000; y los ataques a operadores críticos subieron un 17%, pasando de 341 a 401. En este escenario, la protección de las cuentas de IA se convierte en una prioridad urgente.